Lerndokumentation

8. Dezember 2020

Emanuel Noe Schweizer

Dies ist eine Lerndokumentation von Emanuel Schweizer.

Datum – 8.12.2020

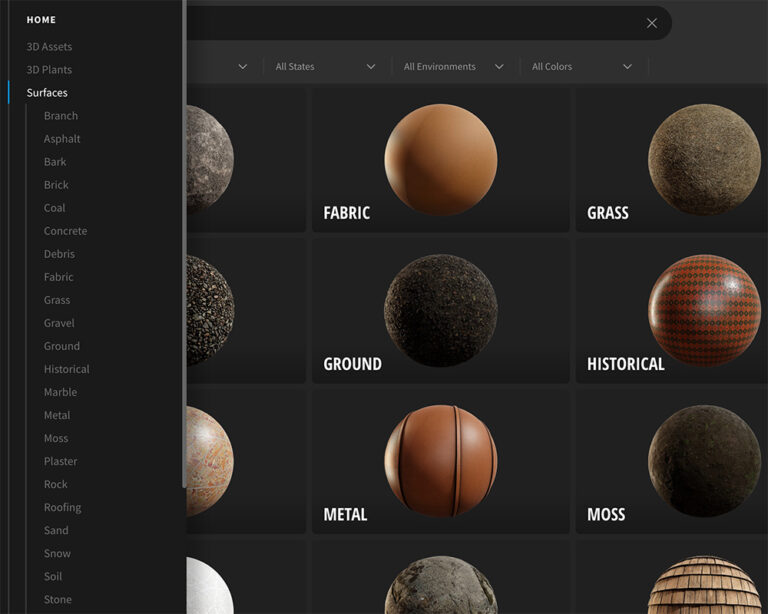

Heute zeigte uns Alexander, wie man die im Blender entwickelten 3D-Objekte im Unreal engine importieren kann. Zudem lernten wir, wie man Wände und weitere Oberflächen direkt im Programm „Unreal Engine“ texturieren kann. Selbstverständlich brachte er uns auch bei, wie das Programm aufgebaut ist und in welchem Fenster man welche Einstellungen erwarten kann. Nebst den vielen vorgefertigten Modellen kann man auch auf zahlreiche Aktionen zugreifen. Diese können dann via drag and drop einfügt und noch weiter modifiziert werden. Alexander demonstrierte uns ein Beispiel mit einer Glühbirne. Sobald der Spieler in einen unsichtbaren Bereich läuft, schaltet automatisch das Licht an. Auf diese Art und Weise können wir in unserem Spiel Wiedereinstiegsorte festlegen. Das heisst, wenn der Spieler Aufgabe 1 meistert, später aber bei Aufgabe 2 scheitert, fängt er nicht nochmals bei Aufgabe 1 an. Was mir persönlich noch nicht ganz verständlich ist, ist wie man diese „Blueprints“ selber einrichtet und bearbeitet. Damit eine gewünschte Aktion auch zum Spiel passt, muss man diese in der Regel noch etwas anpassen. Ich möchte zu einem späteren Zeitpunkt nämlich auch verstehen, wie ich mehrere Aktionen gleichzeitig auslösen kann. Dann kann ich nämlich bestimmen, dass wenn der Spieler in die Nähe einer Tür kommt, diese aufgeht und bei Eintritt das Licht angeht.

Das Fenster für die „Blueprint“-Einstellungen ähnelt einem funktionierenden Prototyp in Adobe XD. Besonders wenn man noch nie damit gearbeitet hat, fällt es einem schwer, die Kästchen richtig miteinander zu verbinden.

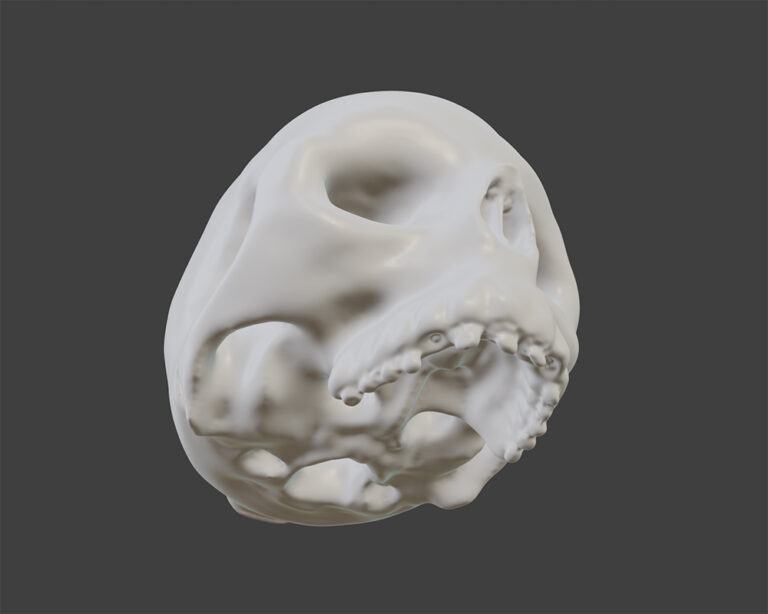

Am Nachmittag arbeitete ich anschliessend an meinen zwei Objekten weiter. Besonders die UV-Map musste ich noch stark verbessern. Ich habe herausgefunden, dass man unter dem Tab „UV“ „Pack islands“ auswählen kann und damit alle Objekte auf der UV-Map passend ausrichtet. Dies ist vor allem dann wichtig, wenn einzelne Flächen manuell neu anordnet werden. Bei meinem Schädel musste ich so einige Stunden in das UV-Mapping investieren. Ich dachte nämlich, dass ich so wenig Schnitte wie nur möglich definieren sollte. Obwohl dies stimmt, ging dieser Grundsatz bei meinem Objekt nicht wirklich auf. Ich musste einige Kanten definieren, um in Quixel Mixer ein scharfes Resultat zu erzielen. Dies ist jedoch nicht weiter schlimm, da meine Textur kein gut erkennbares Muster aufweist. Ich musste also ein wenig experimentieren. Am Schluss kam ich zu einem Resultat, dass sich auf jeden Fall sehen lassen kann. Quixel Mixer hat kein Problem die UV-Map darzustellen und auch die Auflösung der Textur ist an allen Stellen optimal. Die Kanten sieht man nur, wenn jemand weiss, wo sie sich befinden und das UV-Mapping weist keine grossen Verzerrungen auf. Ich habe unter anderem noch etwas Wichtiges im Quixel Mixer herausgefunden. Wenn man möchte, dass Quixel auf die Daten der UV-Map zugreift, muss auf der ausgewählten Ebene unter „Placement” von „Box Projection“ auf „Tiling” umstellt werden. Zudem sollte beim Importieren einer FBX-Datei darauf achtet werden, dass der „File type“ auf FBX (.fbx) eingestellt ist. Dadurch lassen sich bei Apple Geräten Importfehler vermeiden.